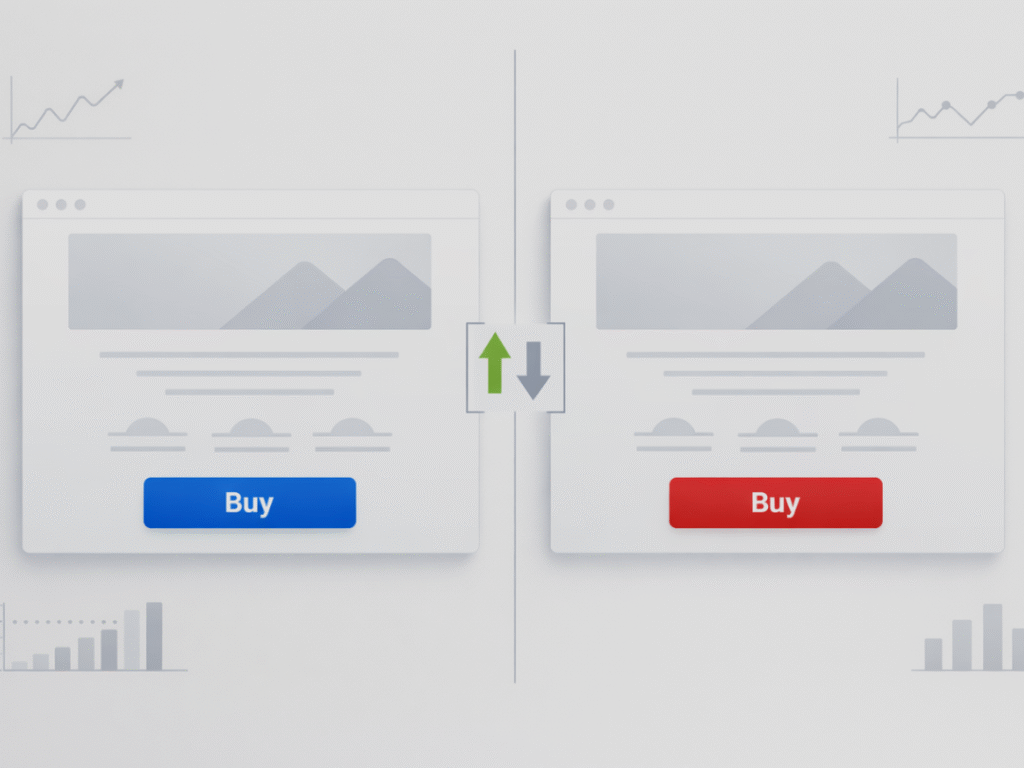

Você tem uma hipótese: acredita que mudar a cor do botão de “Comprar” de azul para vermelho aumentará as conversões. Mas como você sabe se está certo? Poderia ser que a cor vermelha assuste seus clientes. Ou talvez a cor não importe tanto quanto o tamanho do botão. Sem dados, você está apenas chutando.

É aqui que entra o Teste A/B. Em vez de confiar em intuição ou em “boas práticas” que funcionaram para outra empresa, você coloca sua hipótese à prova com dados reais do seu público. Um Teste A/B (também chamado de split test) é um experimento controlado em que você compara duas versões de uma página ou elemento para descobrir qual gera mais conversões.

O que é um Teste A/B?

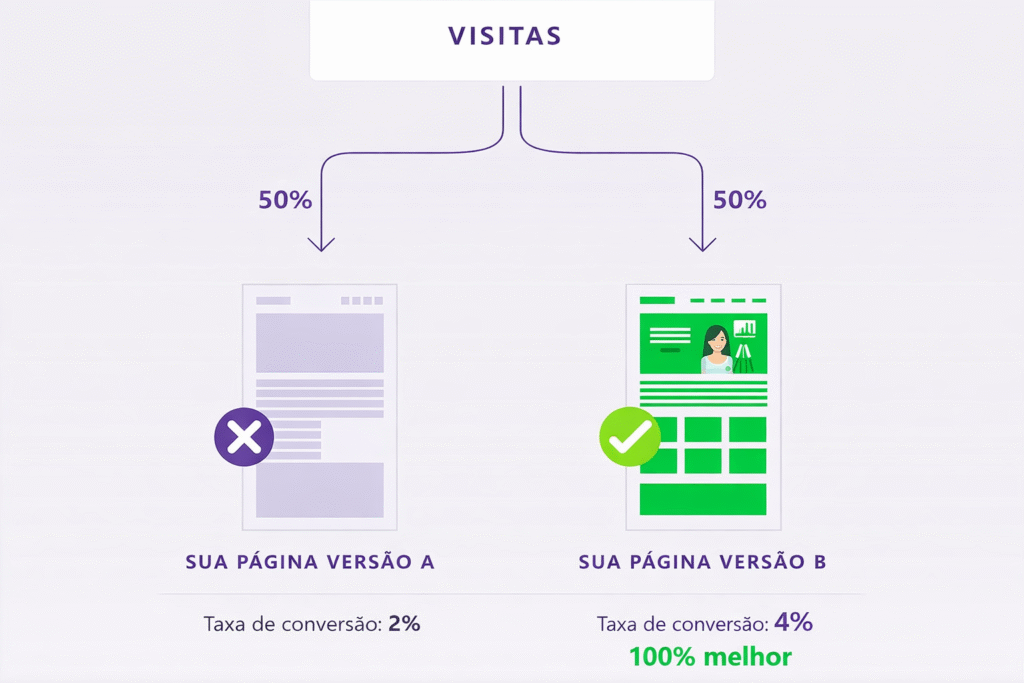

Um Teste A/B é um experimento em que você divide o tráfego do seu site entre duas versões: a versão original (Controle ou Versão A) e uma versão modificada (Variante ou Versão B). Cada visitante vê apenas uma das versões, e você mede qual delas gera mais conversões.

A fórmula é simples:

Taxa de Conversão = (Conversões / Visitantes) × 100Se a Versão A teve 100 visitantes e 5 conversões (5%), e a Versão B teve 100 visitantes e 8 conversões (8%), a Versão B é a vencedora. Mas há um detalhe importante: essa diferença precisa ser estatisticamente significativa, não apenas sorte.

Como Funciona um Teste A/B na Prática

Vamos detalhar cada etapa:

1. Definição da Hipótese

Tudo começa com uma hipótese clara e testável. Não é “vamos melhorar o site”, mas sim:

“Acreditamos que aumentar o tamanho do botão de CTA resultará em mais cliques, porque usuários têm dificuldade em encontrá-lo no tamanho atual.”

Essa hipótese tem três componentes: a mudança (aumentar tamanho), o resultado esperado (mais cliques) e a justificativa (baseada em dados ou psicologia).

2. Criação das Versões

Você cria a Versão B com a mudança proposta. A Versão A permanece idêntica. Importante: mude apenas um elemento por teste. Se você mudar a cor E o tamanho do botão ao mesmo tempo, não saberá qual das duas mudanças causou o resultado.

3. Divisão do Tráfego

O tráfego é dividido entre as duas versões. A divisão mais comum é 50/50, mas se a página é crítica para o negócio, você pode usar 70/30 para minimizar risco (70% na versão original, 30% na variante).

4. Coleta de Dados

Ferramentas como Varify, VWO ou Optimizely rastreiam quantos visitantes viram cada versão e quantos converteram. Isso gera dados brutos para análise.

5. Análise de Resultados

Após um período estatisticamente relevante (geralmente 2-4 semanas), você analisa os resultados. A pergunta é: a diferença é real ou apenas sorte?

Para responder isso, você precisa de relevância estatística (geralmente 95% de confiança). Isso significa que há apenas 5% de chance de o resultado ser sorte. Ferramentas de teste A/B calculam isso automaticamente.

6. Implementação ou Aprendizado

Se a Versão B venceu, ela é implementada para 100% do tráfego. Se perdeu, você aprende o que não funciona e testa outra hipótese. Se o resultado foi inconclusivo, você pode estender o teste ou aumentar o tamanho da amostra.

Quando Usar Teste A/B

Teste A/B é poderoso, mas não é a solução para tudo. Use-o quando:

- Você tem uma hipótese clara: Não é “vamos testar tudo”, mas sim uma mudança específica baseada em análise ou psicologia.

- Tem tráfego suficiente: Para atingir relevância estatística, você precisa de volume. Um site com 100 visitantes por mês levará meses para ter um resultado confiável. Um site com 10.000 visitantes por mês pode ter resultados em dias.

- A mudança é reversível: Se você quer testar uma nova cor de botão, ótimo. Se quer testar uma mudança de infraestrutura que quebra o site, não.

- O impacto é mensurável: Você consegue rastrear a métrica que importa (cliques, conversões, tempo na página, etc.).

Não use Teste A/B quando:

- Você não tem hipótese: “Vamos testar cores aleatoriamente” não é uma estratégia. Comece com análise heurística ou dados qualitativos.

- Tem muito pouco tráfego: Se seu site tem 10 visitantes por dia, testes A/B não são viáveis. Foque em análise heurística e implementação de boas práticas.

- A mudança é óbvia: Se você descobre que seu botão “Comprar” não funciona, não precisa testar. Conserte imediatamente.

- Não consegue rastrear a métrica: Se você não sabe quantas pessoas converteram, não pode fazer um teste A/B confiável.

Erros Comuns em Testes A/B

Mesmo com boa intenção, muitos testes A/B falham. Aqui estão os erros mais comuns:

1. Parar o Teste Cedo Demais

Você vê que a Versão B está ganhando no dia 3 e interrompe o teste. Mas a diferença pode não ser estatisticamente significativa. Deixe o teste rodar até atingir a confiança de 95%.

2. Testar Múltiplos Elementos

Você muda a cor, o tamanho e o texto do botão ao mesmo tempo. Se a Versão B vencer, qual mudança causou o resultado? Sempre teste um elemento por vez.

3. Não Ter uma Hipótese Clara

“Vamos testar essa página” não é uma hipótese. “Acreditamos que aumentar o tamanho da fonte aumentará a legibilidade e reduzirá a taxa de rejeição” é.

4. Ignorar Sazonalidade

Se você testa um produto de Natal em Janeiro, os resultados não são válidos para Dezembro. Considere o contexto temporal.

5. Não Documentar Aprendizados

Mesmo que o teste perca, há um aprendizado valioso. Documente: “Testamos aumentar o tamanho do botão e não funcionou. Próxima hipótese: testar a cor.”

Teste A/B vs. Análise Heurística: Qual Vem Primeiro?

A resposta é: análise heurística primeiro, depois teste A/B.

A análise heurística identifica problemas óbvios rapidamente (sem dados). Teste A/B valida mudanças específicas (com dados). Se você começar com testes A/B, pode gastar semanas testando coisas que uma análise heurística teria identificado em horas.

Fluxo ideal:

- Análise Heurística → Identifica problemas

- Hipóteses → Transforma problemas em ideias testáveis

- Priorização (ICE, PIE) → Escolhe qual testar primeiro

- Teste A/B → Valida a hipótese com dados

- Implementação → Aplica o vencedor

Conclusão

Teste A/B é a ferramenta mais poderosa de CRO porque transforma achismo em dados. Mas é apenas uma ferramenta. O verdadeiro poder vem de combinar análise heurística, psicologia do consumidor e testes A/B em um processo contínuo de aprendizado.

Lembre-se: um teste que perde é tão valioso quanto um que vence. Ambos ensinam algo sobre seu público.

Perguntas frequentes

Quanto tempo um teste A/B deve durar?

Depende do seu tráfego. Um site com 10.000 visitantes por mês pode ter um resultado em 1-2 semanas. Um com 1.000 visitantes pode levar 2-3 meses. A regra é: deixe rodar até atingir 95% de confiança estatística.

Posso fazer teste A/B com pouco tráfego?

Tecnicamente sim, mas os resultados levarão muito tempo. Se seu site tem menos de 1.000 visitantes por mês, foque em análise heurística e implementação de boas práticas. Testes A/B são mais viáveis com tráfego maior.

Qual é a diferença entre Teste A/B e Teste Multivariado?

Teste A/B compara duas versões. Teste multivariado testa múltiplas variações de múltiplos elementos ao mesmo tempo. Multivariado é mais complexo e exige mais tráfego, mas pode ser mais eficiente se bem planejado.

Se a Versão B perder, significa que a ideia é ruim?

Não necessariamente. Significa que essa versão específica não funcionou. Talvez o tamanho do botão estava certo, mas a cor estava errada. Teste novamente com uma variação diferente.